Os serviços tradicionais de cloud baseados em IA dependem fortemente de centros de dados centralizados de grande dimensão. Embora este modelo ofereça poder computacional significativo, acarreta custos elevados de GPU, gestão centralizada de recursos e desafios de escalabilidade. A Theta EdgeCloud propõe-se resolver estas questões integrando Edge Node com computação em cloud, aproveitando GPUs inativas a nível global para aumentar a utilização dos recursos e potenciar a colaboração distribuída.

Com a intensificação da concorrência na infraestrutura de IA, a Theta EdgeCloud afirma-se como um caso de referência em DePIN (Decentralized Physical Infrastructure Network) e em redes distribuídas de GPU. O seu objetivo não é substituir totalmente as plataformas cloud tradicionais, mas sim disponibilizar um modelo mais flexível de colaboração de recursos em cenários de inferência de IA e computação edge.

## O que é a Theta EdgeCloud

A Theta EdgeCloud é uma plataforma híbrida de cloud para IA desenvolvida no ecossistema [Theta Network](https://www.gate.com/pt/learn/articles/what-is-theta-network). A sua abordagem consiste em combinar Edge Node distribuído com serviços tradicionais de GPU em cloud, formando uma rede unificada de recursos computacionais.

Diferenciando-se dos serviços convencionais de cloud de IA centralizados, a Theta EdgeCloud obtém a sua capacidade computacional não só de servidores cloud, mas também de [Edge Node](https://www.gate.com/pt/learn/articles/theta-node-architecture) operados por utilizadores em todo o mundo. Estes Edge Node permitem partilhar recursos inativos de GPU, CPU e largura de banda para tarefas de inferência de IA, transcodificação de vídeo e renderização.

Para programadores, a Theta EdgeCloud atua como uma camada dinâmica de computação de IA com recursos distribuídos. Não é necessário gerir diretamente os nodos—basta submeter as tarefas na plataforma, sendo a alocação e execução dos recursos geridas automaticamente pelo sistema.

## Como a Theta EdgeCloud se distingue dos serviços tradicionais de cloud para IA

As plataformas tradicionais de cloud para IA dependem de centros de dados centralizados que fornecem serviços de GPU, com a gestão de recursos a cargo do fornecedor cloud. Este modelo, embora maduro e estável, é vulnerável a escassez de GPU e ao aumento dos custos.

A Theta EdgeCloud destaca-se pela “partilha de recursos edge”. O Edge Node pode estar em qualquer parte do mundo, permitindo reutilizar GPUs inativas. Quando uma tarefa de IA é submetida, a plataforma aloca recursos de acordo com os requisitos da tarefa, o estado dos nodos e a capacidade computacional.

Principais diferenças entre a Theta EdgeCloud e as plataformas cloud tradicionais de IA:

| Dimensão de comparação | Plataforma tradicional de cloud para IA | Theta EdgeCloud |

| --- | --- | --- |

| Origem dos recursos | Centro de dados centralizado | GPU em cloud + Edge Node |

| Estrutura da rede | Centralizada | Distribuída |

| Agendamento de GPU | Gerido pela plataforma | Coordenação dinâmica de nodos |

| Participação dos nodos | Fornecedor cloud | Recursos partilhados por utilizadores |

| Mecanismo de incentivos | Pagamento pelo serviço | Recompensas TFUEL |

Esta abordagem faz da Theta EdgeCloud uma rede distribuída de GPU, e não apenas uma plataforma cloud convencional.

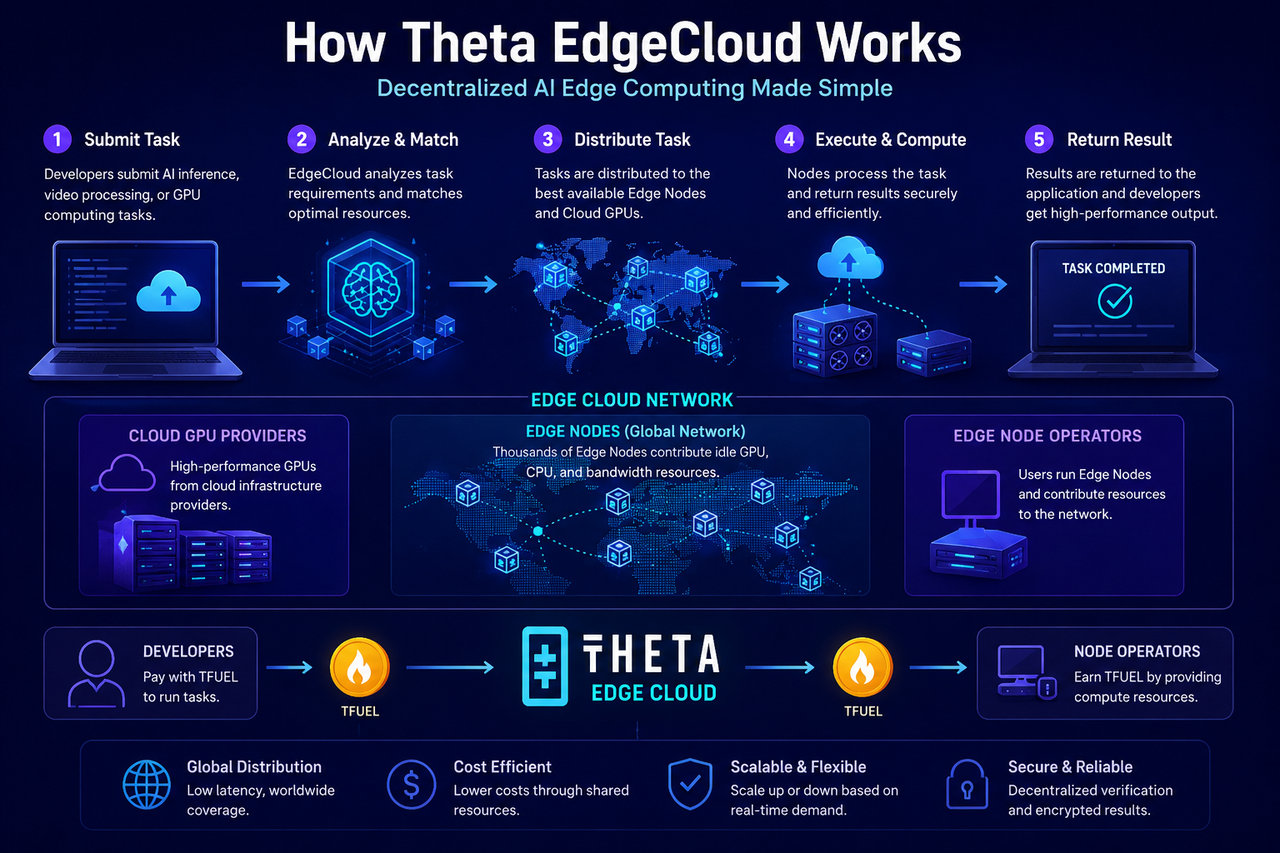

## O que acontece após a submissão de uma tarefa de IA

Quando um programador ou aplicação submete uma tarefa de inferência de IA, processamento de vídeo ou renderização, a Theta EdgeCloud analisa os requisitos de recursos—tipo de GPU, VRAM, tempo de computação e largura de banda.

O sistema identifica então os nodos mais adequados na rede. Algumas tarefas são realizadas por GPUs em cloud, outras são atribuídas a Edge Node em todo o mundo para processamento colaborativo. O processo é automatizado, dispensando a seleção manual de nodos por parte dos programadores.

Durante a execução, o sistema monitoriza permanentemente o estado dos nodos e o progresso das tarefas. Se algum nodo ficar offline ou não tiver recursos suficientes, a tarefa é automaticamente reatribuída para assegurar a estabilidade computacional.

No final, os resultados são devolvidos à camada de aplicação e os nodos participantes recebem [recompensas TFUEL](https://www.gate.com/pt/learn/articles/theta-vs-tfuel) de acordo com o contributo dos seus recursos.

Na prática, este modelo funciona como um “sistema de agendamento de recursos distribuídos”, concebido para unificar e maximizar a utilização da capacidade computacional inativa da rede.

## Como o Edge Node participa na computação GPU

O Edge Node é fundamental na Theta EdgeCloud. Ao executar um Edge Node, os utilizadores ligam os seus recursos locais de GPU e computação à rede Theta.

Sempre que a rede necessita de inferência de IA, renderização de vídeo ou computação edge, estes Edge Node recebem tarefas dinâmicas. Após a execução, os Edge Node recebem recompensas TFUEL proporcionais ao seu contributo computacional.

Ao contrário das máquinas de mineração tradicionais, o Theta Edge Node não se destina à mineração PoW; o seu foco é fornecer recursos computacionais reais. Este aspeto justifica a classificação da Theta como projeto DePIN.

Para os utilizadores, o Edge Node funciona como porta de entrada na rede Theta e é peça-chave na estrutura de partilha de recursos.

## Como circula o TFUEL na EdgeCloud

O TFUEL é o token de utilidade fundamental da Theta EdgeCloud, servindo para pagamentos e incentivos na rede.

Os programadores pagam TFUEL como taxa de recurso ao submeter tarefas de IA ou vídeo. O sistema distribui depois uma parte do TFUEL pelos Edge Node que participam no processamento, em função do desempenho na tarefa.

Na estrutura EdgeCloud, o TFUEL liga:

- Programadores de aplicações de IA

- Fornecedores de recursos GPU

- A rede de Edge Node

- A infraestrutura Theta

Assim se cria um ciclo contínuo de “pagamento de tarefas—execução de recursos—recompensa dos nodos”.

## Principais cenários de aplicação da Theta EdgeCloud

A Theta EdgeCloud foca-se principalmente na computação de IA e media.

Na IA, os casos de utilização incluem:

- Inferência de modelos de IA

- Inferência de grandes modelos de linguagem

- Geração de imagens

- Computação GPU distribuída

No vídeo e media, a Theta EdgeCloud suporta:

- Transcodificação de vídeo

- Renderização de vídeo

- Transmissão em direto

- Distribuição de conteúdos em edge

Como o Edge Node está distribuído globalmente, tarefas sensíveis à latência beneficiam de menor atraso através da computação edge.

Com a integração da IA na infraestrutura Web3, a Theta EdgeCloud assume um papel central na expansão da Theta do ecossistema de vídeo para o domínio da IA.

## Que desafios enfrenta a Theta EdgeCloud

Embora as redes GPU distribuídas tragam vantagens em partilha de recursos e escalabilidade, a Theta EdgeCloud enfrenta alguns desafios concretos.

Primeiro, o hardware do Edge Node é heterogéneo, e diferenças no desempenho das GPU podem afetar a eficiência das tarefas. A natureza distribuída também complexifica o agendamento de recursos e a gestão das tarefas.

Simultaneamente, o mercado de infraestrutura de IA torna-se cada vez mais competitivo, com plataformas cloud tradicionais e outros projetos de GPU distribuída a disputarem quota de mercado.

Além disso, à medida que cresce a procura de IA generativa por GPUs de alto desempenho, garantir a aquisição e alocação fiável destes recursos torna-se um desafio estratégico de longo prazo para a EdgeCloud.

## Resumo

A Theta EdgeCloud, plataforma descentralizada de IA e computação edge da Theta Network, foi criada para construir uma rede de computação de IA distribuída, tirando partido em simultâneo do Edge Node global e das GPUs em cloud.

Diferenciando-se dos serviços centralizados de cloud de IA, a Theta EdgeCloud privilegia a partilha de recursos edge, a coordenação de GPUs e o agendamento distribuído. Os programadores podem submeter tarefas de inferência de IA e processamento de vídeo na plataforma, enquanto nodos em todo o mundo contribuem com recursos e recebem TFUEL como recompensa.

Com o aumento da procura por inferência de IA e GPUs, a Theta EdgeCloud está a impulsionar a transformação da Theta de uma rede de streaming de vídeo para uma plataforma global de infraestrutura de IA.

## Perguntas frequentes

### Como funciona a Theta EdgeCloud?

Após a submissão de uma tarefa de IA ou vídeo, o sistema atribui-a automaticamente a GPUs em cloud e a Edge Node para processamento colaborativo, sendo o TFUEL utilizado para pagamentos e recompensas de recursos.

### Qual é o papel do Edge Node na EdgeCloud?

O Edge Node disponibiliza recursos de GPU e computação para tarefas de inferência de IA, renderização de vídeo e computação edge.

### Em que difere a Theta EdgeCloud dos serviços cloud de IA tradicionais?

As clouds de IA tradicionais baseiam-se em centros de dados centralizados, enquanto a Theta EdgeCloud recorre tanto a Edge Node como a GPUs em cloud para criar uma rede de recursos distribuída.

### Para que serve o TFUEL na EdgeCloud?

O TFUEL serve para pagar tarefas de IA e vídeo, sendo também o token de recompensa para os nodos que completam tarefas.

### A Theta EdgeCloud é um projeto DePIN?

Dado o foco na partilha de recursos de GPU e computação edge, a Theta EdgeCloud é frequentemente classificada como projeto DePIN e de rede GPU distribuída.

2026-05-08 06:25:15