這可能是結束戰爭、地面入侵或推出一個山寨幣的開始。你就只是永遠不知道

查看原文- 打賞

- 按讚

- 留言

- 轉發

- 分享

#ClaudeCode500KCodeLeak 過去的24小時對整個AI產業來說是一個現實檢驗。所謂的Claude大量內部程式碼洩露事件不僅僅是另一個技術失誤——它是一個信號、一個警告,說實話,也是將炒作與紀律區分開來的時刻。對於一個自稱為AI安全黃金標準的公司來說,這次事件的影響不同尋常。它提出了一個簡單但令人不舒服的問題:如果“最注重安全”的實驗室都能在這個規模上出錯,那麼整個AI競賽的基礎有多安全?

在我看來,這不僅僅是某一家公司犯了一個錯。這關乎AI領域的快速發展與這些組織實際準備應對速度的差距。每個人都在競爭打造更智能、更快、更強大的模型——但安全性、內部控制和運營紀律往往落後於創新。而當它們落後時,就會發生類似這樣的事件。

讓這個情況更有趣的是規模。我們不是在談論一個小漏洞或一次數據曝光。這是核心知識產權、多年研究、工程決策和系統架構的潛在曝光。這會在一夜之間改變競爭格局。它降低了競爭者的門檻,加快了反向工程,甚至可能重塑未來AI模型的構建方式。

但我個人看法更堅定——我不認為這會放慢AI的發展。反而,它會加快步伐。這類洩露往往會產生連鎖反應。開發者學習得更快,小型團隊獲得平時無法接觸的洞察,創新變得更加去中心化。在某種奇怪的方式下,這類事件無意中可以促進技術的民主化。

然而,也有更黑暗的一面。安全風險增加。惡意行為者可以獲取先進的框架。而信任因素——在AI中已經脆弱—

查看原文在我看來,這不僅僅是某一家公司犯了一個錯。這關乎AI領域的快速發展與這些組織實際準備應對速度的差距。每個人都在競爭打造更智能、更快、更強大的模型——但安全性、內部控制和運營紀律往往落後於創新。而當它們落後時,就會發生類似這樣的事件。

讓這個情況更有趣的是規模。我們不是在談論一個小漏洞或一次數據曝光。這是核心知識產權、多年研究、工程決策和系統架構的潛在曝光。這會在一夜之間改變競爭格局。它降低了競爭者的門檻,加快了反向工程,甚至可能重塑未來AI模型的構建方式。

但我個人看法更堅定——我不認為這會放慢AI的發展。反而,它會加快步伐。這類洩露往往會產生連鎖反應。開發者學習得更快,小型團隊獲得平時無法接觸的洞察,創新變得更加去中心化。在某種奇怪的方式下,這類事件無意中可以促進技術的民主化。

然而,也有更黑暗的一面。安全風險增加。惡意行為者可以獲取先進的框架。而信任因素——在AI中已經脆弱—

- 打賞

- 按讚

- 留言

- 轉發

- 分享

NBA

NBA

創建人@柏仔666

認購進度

0.00%

市值:

$0

更多代幣

杭州39歲姐妹:幣圈笨辦法,賺回4套房

我有個39歲杭州的姐妹,在幣圈深耕10年,靠不追內幕、不賭運氣的“笨辦法”,將12萬本金滾至5000多萬。她生活低調,坐擁4套房產(1套自住、1套贍養父母、2套收租),用十年踐行:幣圈贏家,從來不是靠一時運氣,而是守住簡單卻硬核的交易原則。

今天分享她的6條幣圈生存鐵律,吃透勝過百個指標:

1. 長後回調溫和不崩盤,多是大猛跌緩=主力吸愁

暴長資金悄悄建倉,別被短期波動迷惑,關主節奏比盯單更關鍵。

2. 迭急反彈弱=主力出貨

價格閃崩後難以反彈拉升,基本是資金撤離,別幻想抄底,此時盲目入場易被套。

3. 高位放量未必見頂,縮量才是見頂信號

頂區放量有時是行情衝刺尾聲,真正的行情結束,往往伴隨頂部縮量,而非放量衝高。

4. 底部單放量造假,連續放量才是真底

一次暴量多為主力誘多,只有持續多日放量,才能說明市場共識逐步形成,真底逐步穩固。

5. 炒幣炒的是人心,而非圖形

再複雜的技術指標,終究都指向市場情緒;量能是情緒的直接反映,看懂情緒比抠指標更重要。

6. “無”是醉高交易境界

無欲、無懼、無執,才能在幣圈活得久;耐得住空倉期的枯燥,才有資格迎接大行情。

醉後悅姐叮囑:交易醉大的對手是自己。利好利空、拉盤砸盤都是外因,情緒管理、紀律遵守、心態理性才是決定命運的核心。幣圈不缺機會,更不缺風險,穩中求勝、理性布局,才能走得更遠。

幣圈能贏的,從不

我有個39歲杭州的姐妹,在幣圈深耕10年,靠不追內幕、不賭運氣的“笨辦法”,將12萬本金滾至5000多萬。她生活低調,坐擁4套房產(1套自住、1套贍養父母、2套收租),用十年踐行:幣圈贏家,從來不是靠一時運氣,而是守住簡單卻硬核的交易原則。

今天分享她的6條幣圈生存鐵律,吃透勝過百個指標:

1. 長後回調溫和不崩盤,多是大猛跌緩=主力吸愁

暴長資金悄悄建倉,別被短期波動迷惑,關主節奏比盯單更關鍵。

2. 迭急反彈弱=主力出貨

價格閃崩後難以反彈拉升,基本是資金撤離,別幻想抄底,此時盲目入場易被套。

3. 高位放量未必見頂,縮量才是見頂信號

頂區放量有時是行情衝刺尾聲,真正的行情結束,往往伴隨頂部縮量,而非放量衝高。

4. 底部單放量造假,連續放量才是真底

一次暴量多為主力誘多,只有持續多日放量,才能說明市場共識逐步形成,真底逐步穩固。

5. 炒幣炒的是人心,而非圖形

再複雜的技術指標,終究都指向市場情緒;量能是情緒的直接反映,看懂情緒比抠指標更重要。

6. “無”是醉高交易境界

無欲、無懼、無執,才能在幣圈活得久;耐得住空倉期的枯燥,才有資格迎接大行情。

醉後悅姐叮囑:交易醉大的對手是自己。利好利空、拉盤砸盤都是外因,情緒管理、紀律遵守、心態理性才是決定命運的核心。幣圈不缺機會,更不缺風險,穩中求勝、理性布局,才能走得更遠。

幣圈能贏的,從不

BTC3.6%

- 打賞

- 1

- 留言

- 轉發

- 分享

⚡️ 澳大利亞剛剛通過了其第一部加密貨幣法

交易所和保管服務提供商現在必須取得AFS牌照。這個新框架引入了受規範的加密貨幣類別以及對客戶資金濫用的更強保護。$BTC #CryptoMarketsRiseBroadly

交易所和保管服務提供商現在必須取得AFS牌照。這個新框架引入了受規範的加密貨幣類別以及對客戶資金濫用的更強保護。$BTC #CryptoMarketsRiseBroadly

BTC3.78%

市值:$2275.86持有人數:1

0.00%

- 打賞

- 2

- 留言

- 轉發

- 分享

🚨 $USA 預售今日結束 🚨

Eric Trump 已確認——我已經預測這個好幾個星期了 🚀

🔥 100% 獎勵——僅此一天

🔗 官方預售:

📯 TG:

我們不是在買——我們在印鈔票 👀

如果 $Trump 以零炒作實現了 300 倍……

$USA 明天將令人震驚。

加入或被甩在後面 🐋🚀 $USA $TRUMP

Eric Trump 已確認——我已經預測這個好幾個星期了 🚀

🔥 100% 獎勵——僅此一天

🔗 官方預售:

📯 TG:

我們不是在買——我們在印鈔票 👀

如果 $Trump 以零炒作實現了 300 倍……

$USA 明天將令人震驚。

加入或被甩在後面 🐋🚀 $USA $TRUMP

TRUMP1.44%

- 打賞

- 按讚

- 留言

- 轉發

- 分享

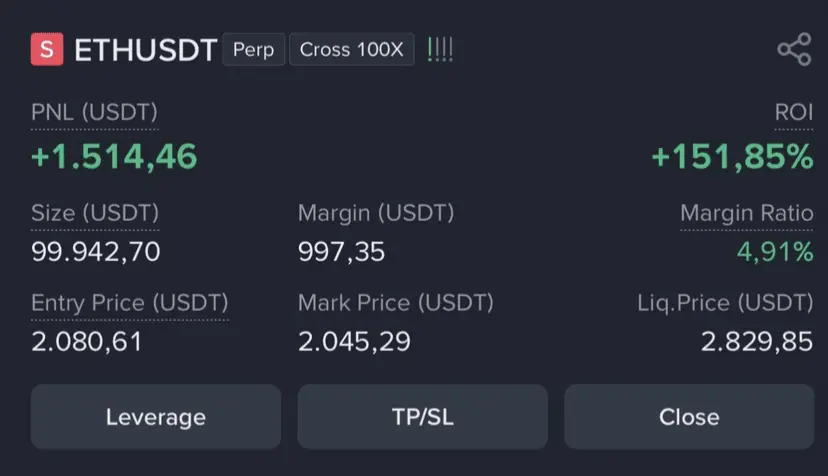

🚨 以太坊決策區域

$ETH 正在測試 $2,150–$2,200 的阻力位。

• 突破並站穩 → 看漲持續

• 在此失敗 → 重新測試 $1,900–$2,000

下一步取決於此水平。

#EthereumFoundationStakes$46.2METH

#CreatorLeaderboard

$ETH 正在測試 $2,150–$2,200 的阻力位。

• 突破並站穩 → 看漲持續

• 在此失敗 → 重新測試 $1,900–$2,000

下一步取決於此水平。

#EthereumFoundationStakes$46.2METH

#CreatorLeaderboard

ETH5.81%

- 打賞

- 按讚

- 留言

- 轉發

- 分享

說個細節。 把第二期 $CWFC 的 Launchpad,卡在 4 月 1 日 開!

多數人會當成一個節奏點,甚至當個玩笑看,但市場從來喜歡在“最不被認真對待的時刻”釋放機會。

如果把 Q1 拆開看,其實答案很清晰:

不是項目在贏,是情緒在贏。

Meme 從 Sol 擴散到 Base,本質是資金在找更高效率的情緒出口。

而現在,這個出口正在往 Launchpad 集中。

再看 $CWFC 的節奏安排:

📍 4 月 4 日 20:00 上線

剛好卡在歐美 + 亞洲的流動性交匯點

這種時間點,不是隨便選的,是直接拿市場做壓力測試。

我不做情緒判斷,只看結構:

視覺記憶點:有(掩面而泣,一眼識別)

參與門檻:不高(利於擴散)

平台推力:在加強(節奏明顯)

這三件事同時成立的時候,項目通常不會太差。

與其在二級拼手速,不如提前在 Launchpad 拿到更低成本的籌碼。剩下的,交給市場驗證。

👉 參與入口:

🔗 註冊:

#Jucom #打新 #Launchpad #Meme #CHIBIPA #CWFC

多數人會當成一個節奏點,甚至當個玩笑看,但市場從來喜歡在“最不被認真對待的時刻”釋放機會。

如果把 Q1 拆開看,其實答案很清晰:

不是項目在贏,是情緒在贏。

Meme 從 Sol 擴散到 Base,本質是資金在找更高效率的情緒出口。

而現在,這個出口正在往 Launchpad 集中。

再看 $CWFC 的節奏安排:

📍 4 月 4 日 20:00 上線

剛好卡在歐美 + 亞洲的流動性交匯點

這種時間點,不是隨便選的,是直接拿市場做壓力測試。

我不做情緒判斷,只看結構:

視覺記憶點:有(掩面而泣,一眼識別)

參與門檻:不高(利於擴散)

平台推力:在加強(節奏明顯)

這三件事同時成立的時候,項目通常不會太差。

與其在二級拼手速,不如提前在 Launchpad 拿到更低成本的籌碼。剩下的,交給市場驗證。

👉 參與入口:

🔗 註冊:

#Jucom #打新 #Launchpad #Meme #CHIBIPA #CWFC

MEME2.07%

- 打賞

- 1

- 留言

- 轉發

- 分享

8T

8 Trend

創建人@GateUser-cae19a10

上市進度

1.03%

市值:

$2430.64

更多代幣

新主播看以太坊

- 打賞

- 按讚

- 留言

- 轉發

- 分享

最近這幾天,有很多1000U左右小資金的朋友都在問,怎麼做滾到5000U甚至1萬U。

其實小紫斤最忌諱的不是賺得慢,而是去得快。滿蒼、重蒼、高槓桿想一把翻倍,往往幾單就歸零。想滾起來,核心就是先活下來。

初期用200-300U試蒼,蒼位別過半,只做趨勢清晰、有支撐壓力、止損明確的行情。每單虧損控制在50-70U,別嫌少,一次大虧就足以廢掉帳戶。止盈不貪,小波段及時落袋。

等紫斤做到3000U再適當提速,風險依舊控制在3%-5%。小紫斤先保命,中等資斤再提速,做大後守利潤。記得適時出斤,心態才穩。

交意沒有捷徑,控蒼、止損、嚴格執行,慢慢滾才能真正做大。#比特币跳水29万人爆仓##币圈##区块链 #BTC☀

其實小紫斤最忌諱的不是賺得慢,而是去得快。滿蒼、重蒼、高槓桿想一把翻倍,往往幾單就歸零。想滾起來,核心就是先活下來。

初期用200-300U試蒼,蒼位別過半,只做趨勢清晰、有支撐壓力、止損明確的行情。每單虧損控制在50-70U,別嫌少,一次大虧就足以廢掉帳戶。止盈不貪,小波段及時落袋。

等紫斤做到3000U再適當提速,風險依舊控制在3%-5%。小紫斤先保命,中等資斤再提速,做大後守利潤。記得適時出斤,心態才穩。

交意沒有捷徑,控蒼、止損、嚴格執行,慢慢滾才能真正做大。#比特币跳水29万人爆仓##币圈##区块链 #BTC☀

BTC3.05%

- 打賞

- 2

- 留言

- 轉發

- 分享

- 打賞

- 按讚

- 留言

- 轉發

- 分享

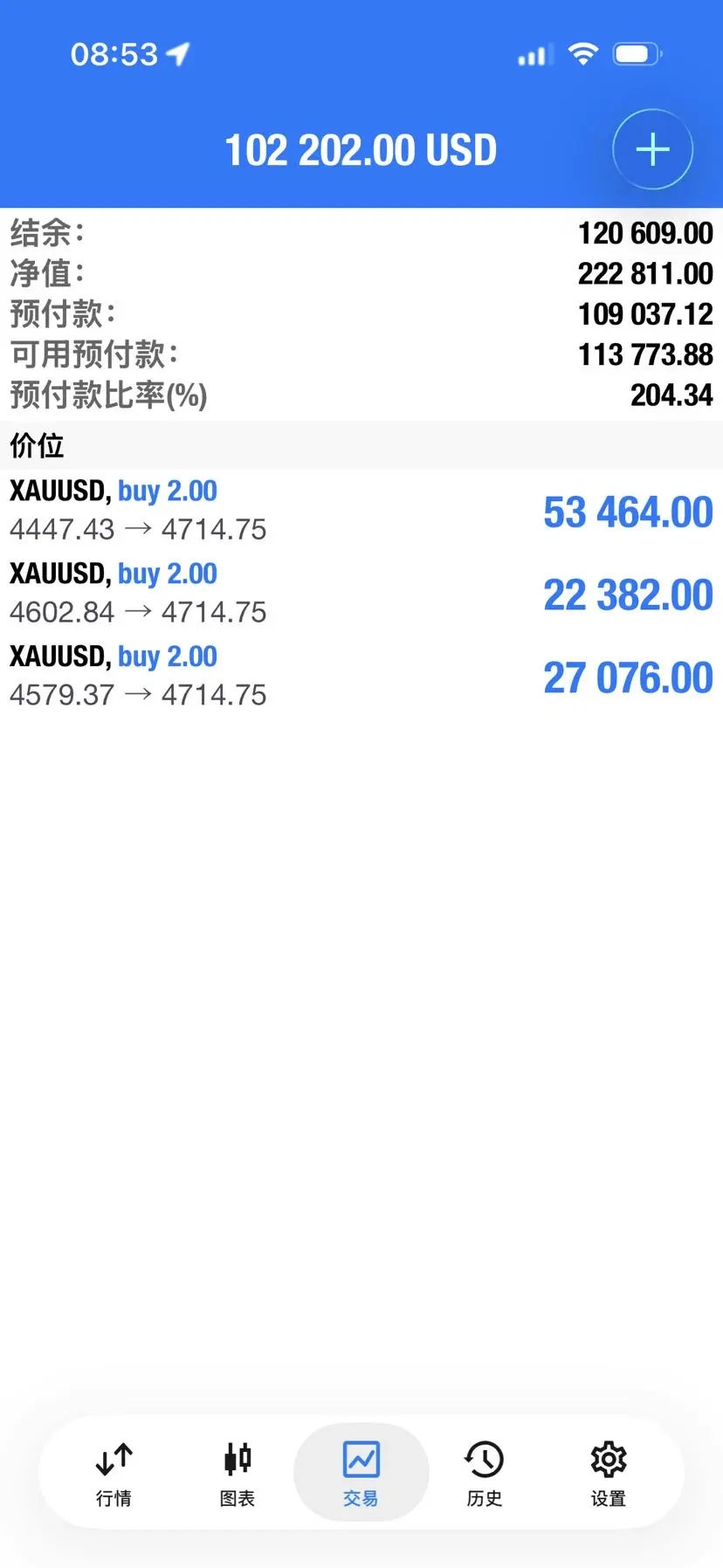

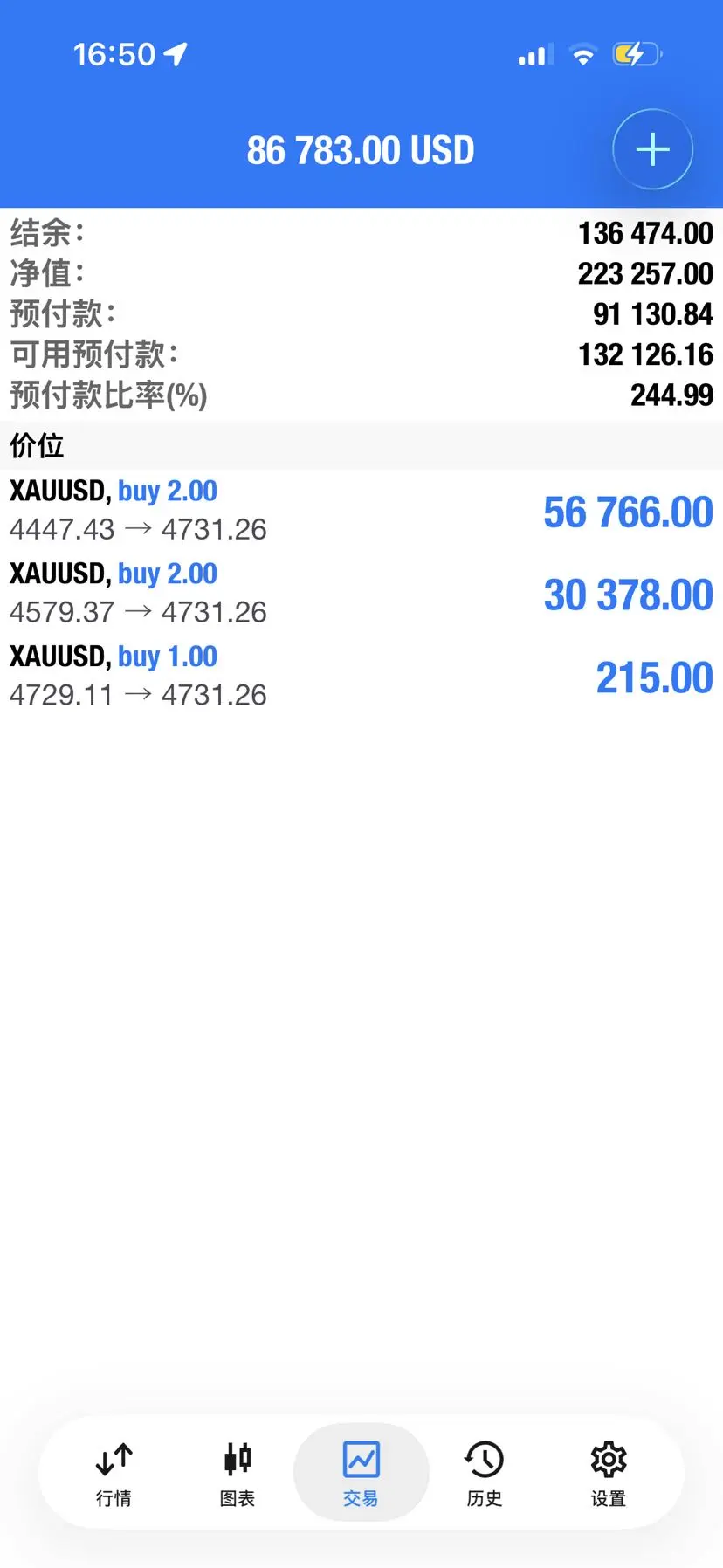

這幾天思路全程在線,節奏精准踩對。

我們布局的中長線目標4800已越來越近,現價已觸及4750附近,4800突破只是時間問題。

查看原文我們布局的中長線目標4800已越來越近,現價已觸及4750附近,4800突破只是時間問題。

- 打賞

- 按讚

- 留言

- 轉發

- 分享

加載更多