KnightMan

#GateSquareAprilPostingChallenge

Gate的Square四月發帖挑戰是一項策略性舉措,旨在提升用戶參與度和內容驅動的成長,並在其生態系統中發揮作用。通過激勵持續發帖,平台鼓勵用戶分享見解、市場分析和意見,有效地將參與者轉變為積極的貢獻者。這不僅增加了平台的活躍度,也加強了社群互動和知識交流。此類活動可以幫助Gate與以社交為導向的加密平台競爭,將交易與內容創作相結合。然而,保持內容質量是一個挑戰,因為基於獎勵的系統可能會促使低價值或重複的帖子。長期成功將取決於在激勵與審核之間取得平衡,確保有意義的高質量內容始終是用戶參與的核心。

查看原文Gate的Square四月發帖挑戰是一項策略性舉措,旨在提升用戶參與度和內容驅動的成長,並在其生態系統中發揮作用。通過激勵持續發帖,平台鼓勵用戶分享見解、市場分析和意見,有效地將參與者轉變為積極的貢獻者。這不僅增加了平台的活躍度,也加強了社群互動和知識交流。此類活動可以幫助Gate與以社交為導向的加密平台競爭,將交易與內容創作相結合。然而,保持內容質量是一個挑戰,因為基於獎勵的系統可能會促使低價值或重複的帖子。長期成功將取決於在激勵與審核之間取得平衡,確保有意義的高質量內容始終是用戶參與的核心。

- 打賞

- 1

- 留言

- 轉發

- 分享

#OilEdgesHigher

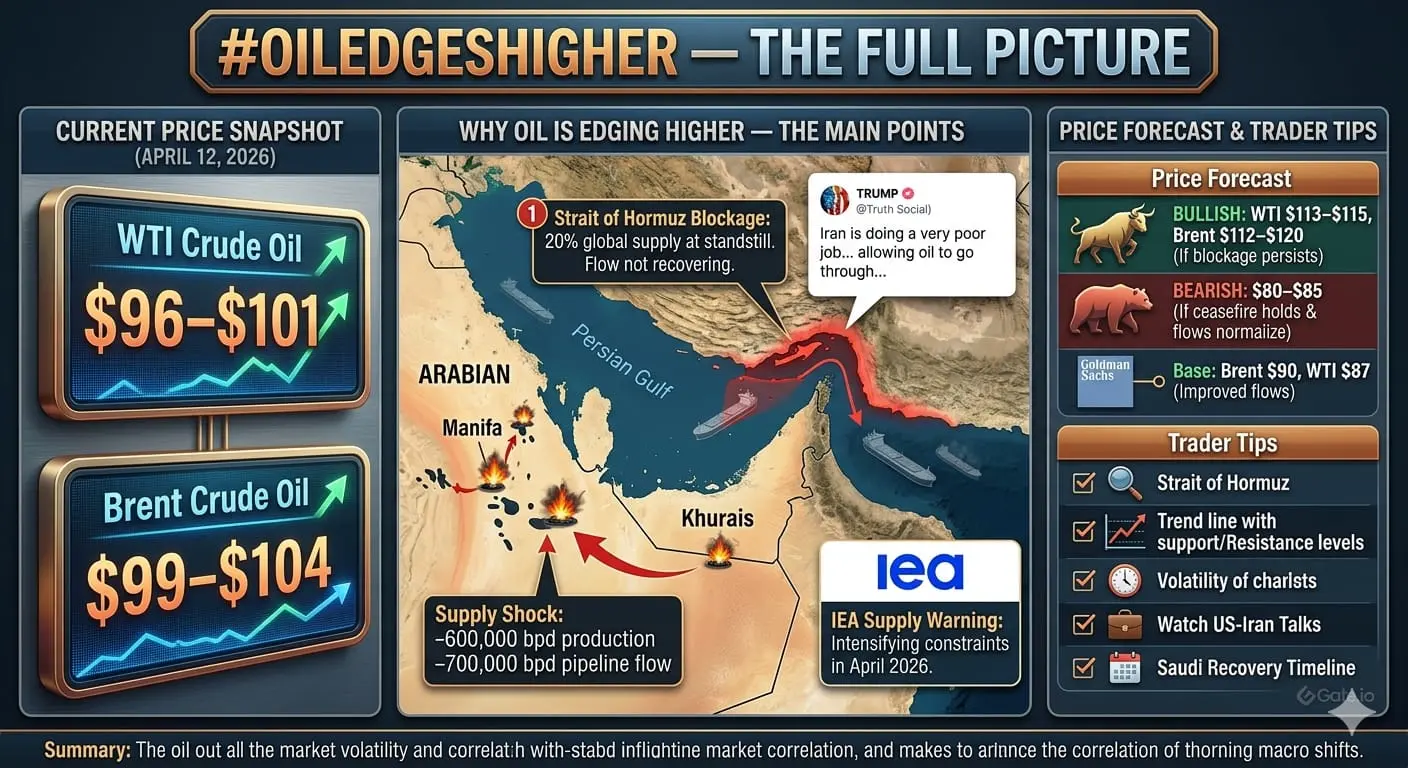

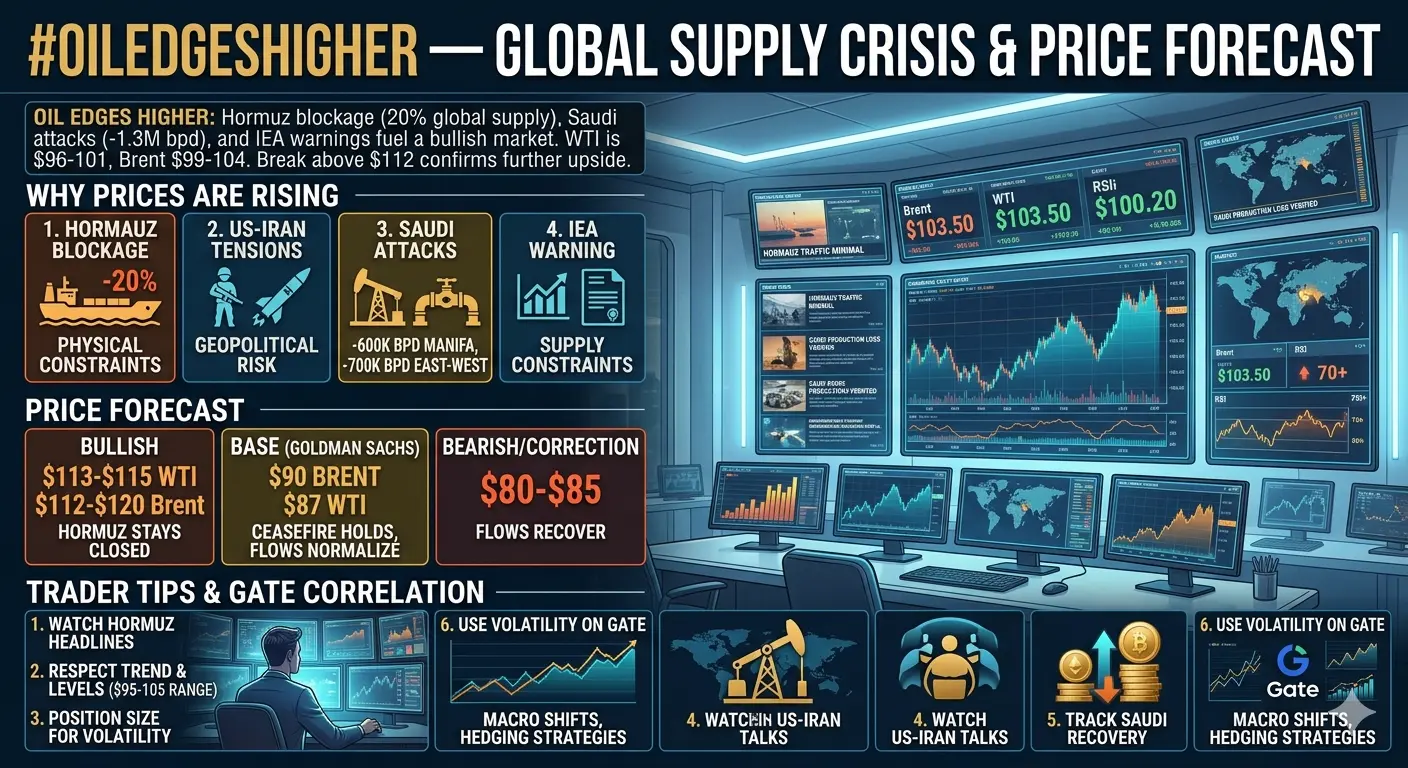

#OilEdgesHigher — 完整圖景:為何油價上漲以及交易者需要知道的事情

當前價格快照 (2026年4月12日)

基準 價格

WTI 原油 -96美元–$101 每桶

布倫特原油 -99美元–$104 每桶

油價一直在一個狹窄但較高的區間徘徊——這個區域幾個月前還會被認為是非凡的。市場目前反應非常敏感,每個中東的頭條都會引起劇烈波動。

為何油價逐步上升——主要點

1. 霍爾木茲海峽封鎖——最大推動力

霍爾木茲海峽,約承載全球每日20%的原油供應,基本處於停滯狀態。儘管美伊之間達成了脆弱的停火協議,通過這條關鍵航道的實體油輪交通幾乎未恢復。特朗普在Truth Social上公開表示:“伊朗做得非常差勁,有人會說不光彩,讓油通過霍爾木茲海峽。”

這不僅僅是地緣政治的噪音——它是真實的、物理上的全球油供應限制。當世界最重要的油阻塞點放慢速度,價格就會相應反應。

2. 美伊軍事緊張局勢——風險溢價持續升高

特朗普總統威脅對伊朗的民用基礎設施進行打擊,包括橋樑和發電廠。儘管達成了停火協議,但其可信度仍存疑。市場將潛在的衝突升級風險計入價格,這使每桶油都帶有相當的地緣政治風險溢價。

3. 沙特基礎設施攻擊——供應衝擊

另外,對沙特阿拉伯的曼菲亞和胡賽油田的攻擊,導致該國產量約減少60萬桶/日(bpd)。此外,東西管道的流量也因基礎設施損壞而削減約70

查看原文#OilEdgesHigher — 完整圖景:為何油價上漲以及交易者需要知道的事情

當前價格快照 (2026年4月12日)

基準 價格

WTI 原油 -96美元–$101 每桶

布倫特原油 -99美元–$104 每桶

油價一直在一個狹窄但較高的區間徘徊——這個區域幾個月前還會被認為是非凡的。市場目前反應非常敏感,每個中東的頭條都會引起劇烈波動。

為何油價逐步上升——主要點

1. 霍爾木茲海峽封鎖——最大推動力

霍爾木茲海峽,約承載全球每日20%的原油供應,基本處於停滯狀態。儘管美伊之間達成了脆弱的停火協議,通過這條關鍵航道的實體油輪交通幾乎未恢復。特朗普在Truth Social上公開表示:“伊朗做得非常差勁,有人會說不光彩,讓油通過霍爾木茲海峽。”

這不僅僅是地緣政治的噪音——它是真實的、物理上的全球油供應限制。當世界最重要的油阻塞點放慢速度,價格就會相應反應。

2. 美伊軍事緊張局勢——風險溢價持續升高

特朗普總統威脅對伊朗的民用基礎設施進行打擊,包括橋樑和發電廠。儘管達成了停火協議,但其可信度仍存疑。市場將潛在的衝突升級風險計入價格,這使每桶油都帶有相當的地緣政治風險溢價。

3. 沙特基礎設施攻擊——供應衝擊

另外,對沙特阿拉伯的曼菲亞和胡賽油田的攻擊,導致該國產量約減少60萬桶/日(bpd)。此外,東西管道的流量也因基礎設施損壞而削減約70

- 打賞

- 7

- 7

- 轉發

- 分享

Baba Ji:

牛市迅速回歸 🐂牛市迅速回歸 🐂查看更多

在加密市場裡很多人把硬扛波動、熬夜盯盤、死拿不放當成交易能力,可市場一次突發波動,就容易讓所有努力歸零。真正的穩健從來不是靠心態硬撐,而是從策略源頭規避多餘風險。

就像 @TermMaxFi 創始人所說:“關鍵不是你能不能扛波動,而是你的倉位從一開始就該做好抗風險準備。”

這一問題在DeFi借貸領域同樣突出。

傳統借貸協議多採用浮動利率,借款成本、存款收益全隨市場供需變動,用戶無法提前預判。今天存入的資金,明天利率可能大幅下跌;借款利率突然走高,还會悄悄侵蝕利潤。利率不可控、資金利用率低,成了DeFi借貸的普遍痛點,資產往往處於低效運轉狀態。

針對這些問題 @TermMaxFi 給出了清晰的解決方案:作為固定利率借貸協議,它圍繞借貸期限、利率與到期收益搭建鏈上結構,用戶在交易之初就能鎖定固定利率,確定整個周期的成本與收益,不用被利率波動牽著走。

這一設計帶來三大核心優勢:

一是利率確定,提前鎖定收益與成本,徹底告別利率浮動帶來的不確定性;

二是資本高效,資金圍繞固定期限與收益運轉,避免閒置或低效使用;

三是決策簡化,無需緊盯市場調整策略,在明確規則下理性操作,減少情緒干擾。

對比傳統浮動利率借貸,TermMax的優勢更為直觀:傳統模式利率實時波動,收益與成本未知,資金易閒置,还需承擔利率飆升帶來的清算風險;TermMax全程固定利率,收益可算、風險可控,操作簡單省心

查看原文就像 @TermMaxFi 創始人所說:“關鍵不是你能不能扛波動,而是你的倉位從一開始就該做好抗風險準備。”

這一問題在DeFi借貸領域同樣突出。

傳統借貸協議多採用浮動利率,借款成本、存款收益全隨市場供需變動,用戶無法提前預判。今天存入的資金,明天利率可能大幅下跌;借款利率突然走高,还會悄悄侵蝕利潤。利率不可控、資金利用率低,成了DeFi借貸的普遍痛點,資產往往處於低效運轉狀態。

針對這些問題 @TermMaxFi 給出了清晰的解決方案:作為固定利率借貸協議,它圍繞借貸期限、利率與到期收益搭建鏈上結構,用戶在交易之初就能鎖定固定利率,確定整個周期的成本與收益,不用被利率波動牽著走。

這一設計帶來三大核心優勢:

一是利率確定,提前鎖定收益與成本,徹底告別利率浮動帶來的不確定性;

二是資本高效,資金圍繞固定期限與收益運轉,避免閒置或低效使用;

三是決策簡化,無需緊盯市場調整策略,在明確規則下理性操作,減少情緒干擾。

對比傳統浮動利率借貸,TermMax的優勢更為直觀:傳統模式利率實時波動,收益與成本未知,資金易閒置,还需承擔利率飆升帶來的清算風險;TermMax全程固定利率,收益可算、風險可控,操作簡單省心

- 打賞

- 按讚

- 留言

- 轉發

- 分享

星星之火

星星之火

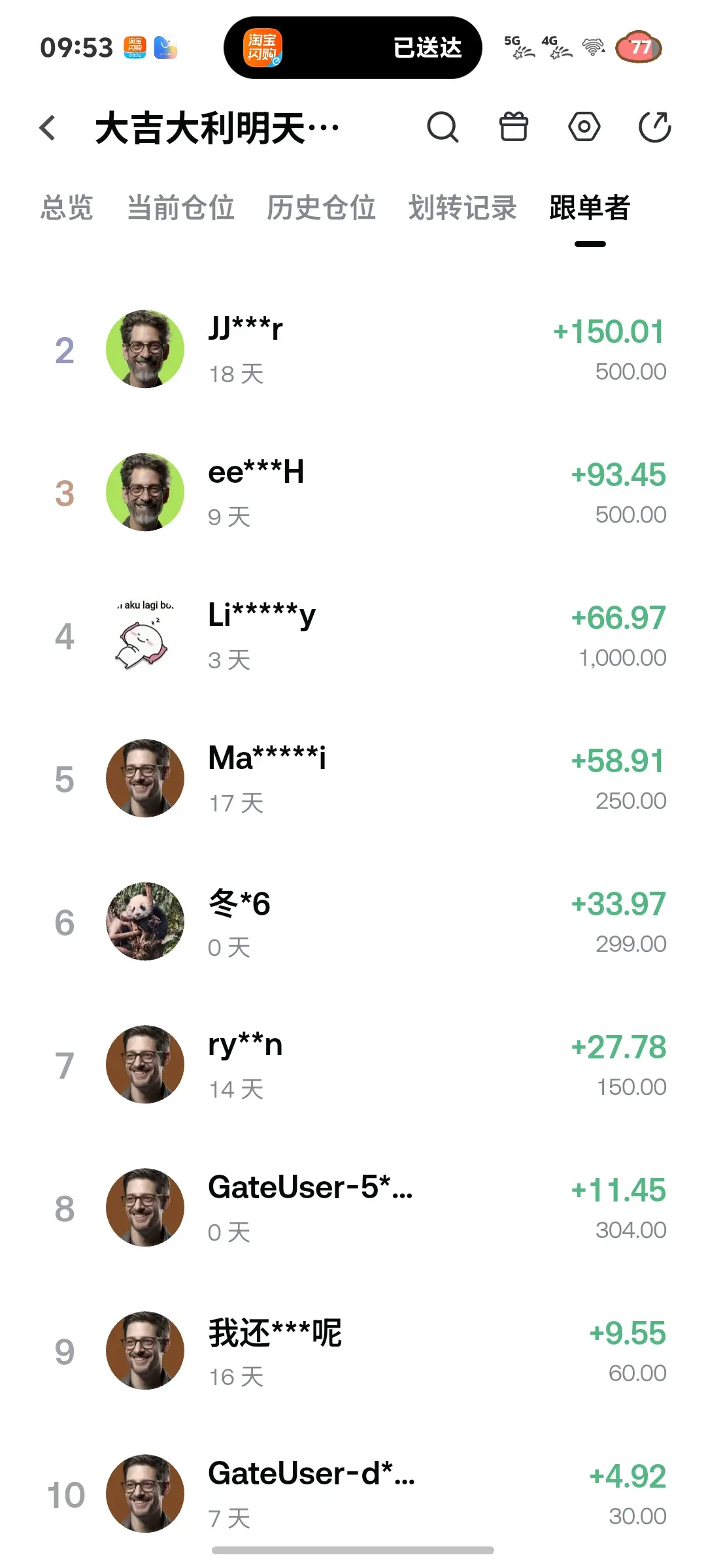

創建人@gatefunuser_936d

上市進度

100.00%

市值:

$1979.53

更多代幣

有任何問題可以在這個評論區反饋。跟單跟隨我的比例。不要調高槓桿。

查看原文

【當前用戶分享了他的交易卡片,若想瞭解更多優質交易資訊,請到 App 版查看】

- 打賞

- 1

- 留言

- 轉發

- 分享

#MetaReleasesMuseSpark 副標題:這家科技巨頭的最新創新旨在民主化3D世界建構與互動式故事講述,挑戰現有的AI影片與設計工具。

發稿日期:[當前日期] – 為了在數位創意的下一個前沿佔據主導地位,Meta正式宣布MuseSpark,一款全新的生成式AI模型,旨在即時產生互動式虛擬環境、3D資產與故事序列,皆可由簡單的文字或圖像提示生成。

與傳統的文字轉圖像模型不同,MuseSpark專為空間計算與元宇宙打造,直接整合於Meta的Horizon Worlds、Quest裝置及未來的AR眼鏡生態系統中。

主要技術能力

1. 即時4D場景生成

MuseSpark不僅生成靜態3D模型;它還創建動態、具物理感知的環境。用戶可以提示「一個浮動書本與移動梯子的未來圖書館」,AI便會輸出一個完全互動、即時的場景,包含照明、碰撞網格與環境動畫。

2. 跨模態一致性

該模型保持嚴格的語義與空間連貫性。例如,描述「一張紅色椅子在天窗下靠近藍色桌子」的提示,會產生幾何位置準確、反射與陰影在各幀中保持一致的效果——這對VR沉浸感至關重要。

3. 低延遲資產串流

利用Meta的推理優化架構,MuseSpark能在500毫秒內生成高解析度網格與PBR(物理基礎渲染)紋理,實現即時世界建構,適用於現場協作。

運作方式

MuseSpark採用一個在專有資料集

查看原文發稿日期:[當前日期] – 為了在數位創意的下一個前沿佔據主導地位,Meta正式宣布MuseSpark,一款全新的生成式AI模型,旨在即時產生互動式虛擬環境、3D資產與故事序列,皆可由簡單的文字或圖像提示生成。

與傳統的文字轉圖像模型不同,MuseSpark專為空間計算與元宇宙打造,直接整合於Meta的Horizon Worlds、Quest裝置及未來的AR眼鏡生態系統中。

主要技術能力

1. 即時4D場景生成

MuseSpark不僅生成靜態3D模型;它還創建動態、具物理感知的環境。用戶可以提示「一個浮動書本與移動梯子的未來圖書館」,AI便會輸出一個完全互動、即時的場景,包含照明、碰撞網格與環境動畫。

2. 跨模態一致性

該模型保持嚴格的語義與空間連貫性。例如,描述「一張紅色椅子在天窗下靠近藍色桌子」的提示,會產生幾何位置準確、反射與陰影在各幀中保持一致的效果——這對VR沉浸感至關重要。

3. 低延遲資產串流

利用Meta的推理優化架構,MuseSpark能在500毫秒內生成高解析度網格與PBR(物理基礎渲染)紋理,實現即時世界建構,適用於現場協作。

運作方式

MuseSpark採用一個在專有資料集

- 打賞

- 4

- 3

- 轉發

- 分享

BeautifulDay:

To The Moon 🌕查看更多

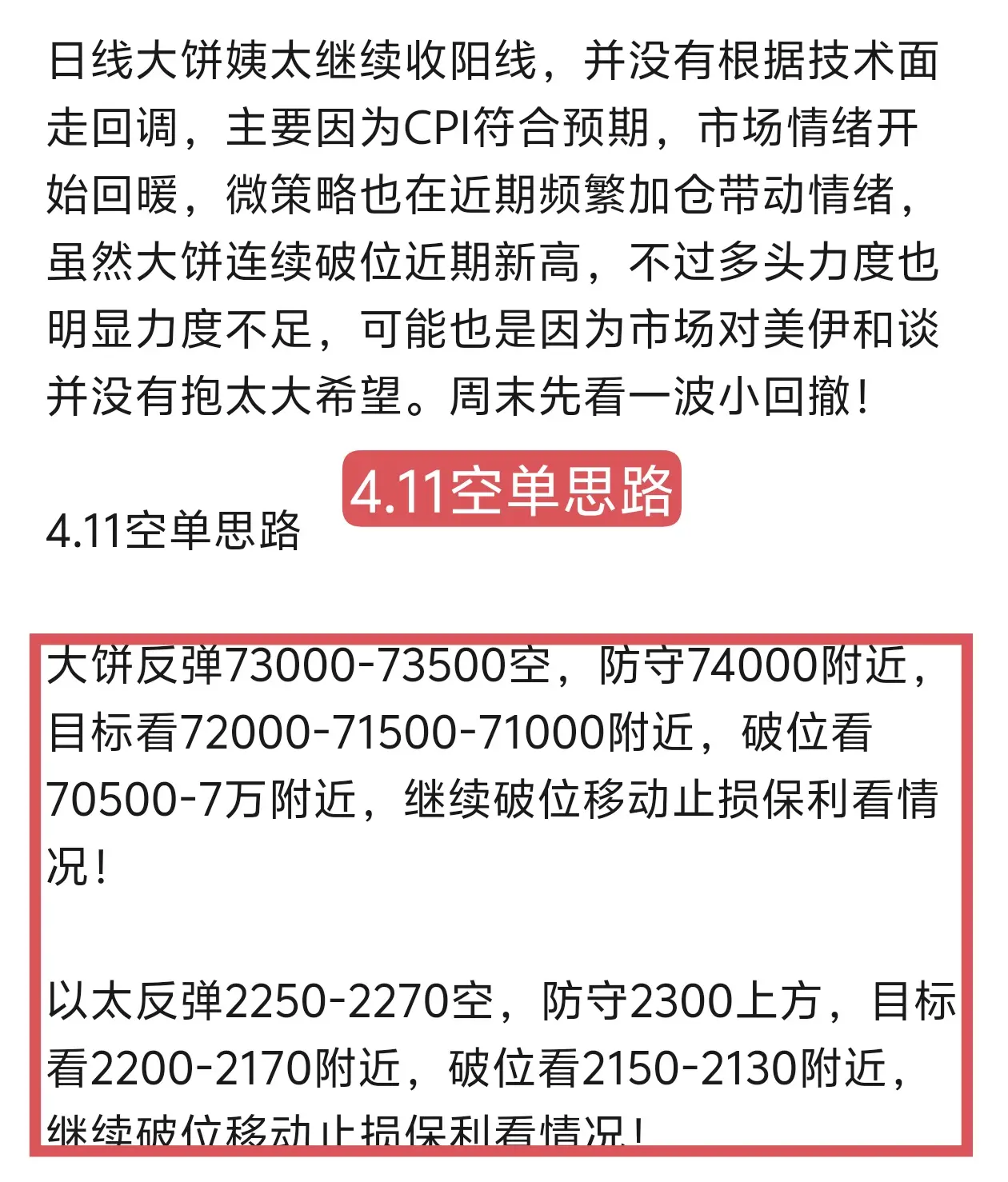

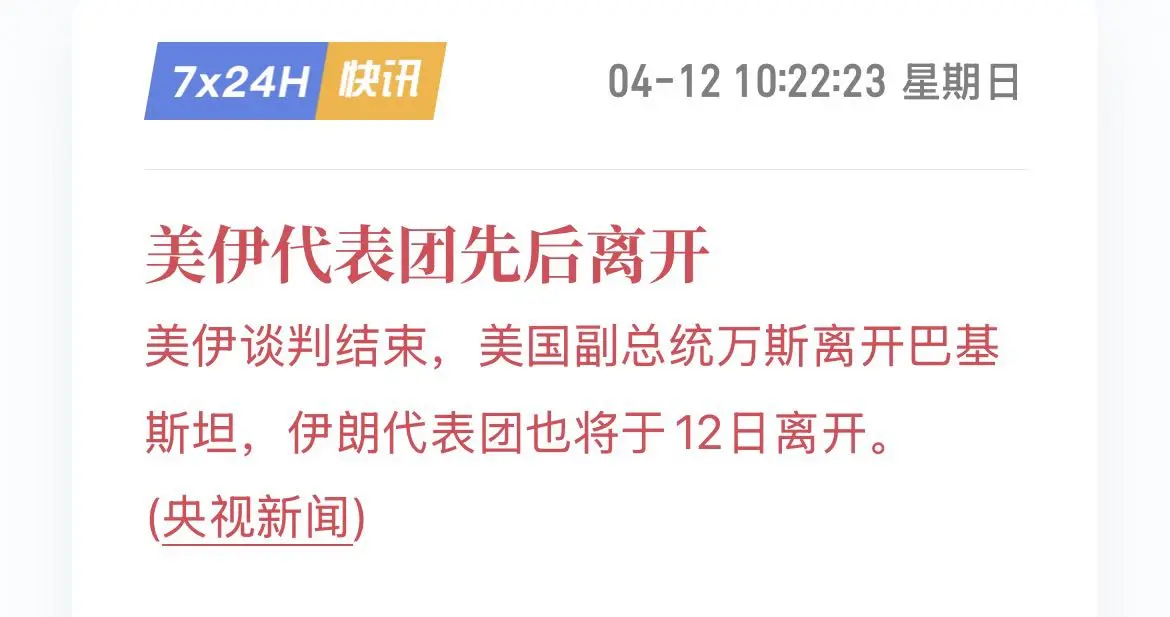

幾輪談判終不成,伊朗明確不會接受美方條件!4.12大餅姨太操作思路

伊朗與美國在伊斯蘭堡的第三輪談判已結束,伊朗方面稱此輪談判為達成框架協議的“最後機會”。11日以來,雙方談判議程密集、磋商至深夜,各方搶抓臨時停火窗口期加緊博弈,但在霍爾木茲海峽管控、海外資產解凍、鈾濃縮三大核心議題上分歧尖銳。談判桌外,美軍宣布在霍爾木茲海峽展開掃雷作業,以色列總理則聲稱將繼續打擊伊朗及其代理人。停火窗口期所剩無幾,外交博弈與軍事動作同步升溫,中東局勢正站在戰爭與和平的十字路口。今早伊朗明確不會接受美方條件,幣價沖高後快速回落,午夜掛的空單幸好還在,目收穫不錯,跟上可以移動止損鎖住收益,耐心拿好!沒上車的反彈繼續

4.12空單思路

大餅反彈73000-73500空,防守74000附近,目標看72000-71500-71000附近,破位看70500-7萬附近,繼續破位移動止損保利看情況!

以太反彈2250-2270空,防守2300上方,目標看2200-2170附近,破位看2150-2130附近,繼續破位移動止損保利看情況!

瀑布已經開始,反彈就繼續,有單子的慢慢移動止損鎖住收益!想追的根據自身倉位帶好止損,目前技術面已經明顯偏弱,加上美伊談判陷入僵局,各位謹慎抄底!#Gate现货衍生品双双冲进全球前三

查看原文伊朗與美國在伊斯蘭堡的第三輪談判已結束,伊朗方面稱此輪談判為達成框架協議的“最後機會”。11日以來,雙方談判議程密集、磋商至深夜,各方搶抓臨時停火窗口期加緊博弈,但在霍爾木茲海峽管控、海外資產解凍、鈾濃縮三大核心議題上分歧尖銳。談判桌外,美軍宣布在霍爾木茲海峽展開掃雷作業,以色列總理則聲稱將繼續打擊伊朗及其代理人。停火窗口期所剩無幾,外交博弈與軍事動作同步升溫,中東局勢正站在戰爭與和平的十字路口。今早伊朗明確不會接受美方條件,幣價沖高後快速回落,午夜掛的空單幸好還在,目收穫不錯,跟上可以移動止損鎖住收益,耐心拿好!沒上車的反彈繼續

4.12空單思路

大餅反彈73000-73500空,防守74000附近,目標看72000-71500-71000附近,破位看70500-7萬附近,繼續破位移動止損保利看情況!

以太反彈2250-2270空,防守2300上方,目標看2200-2170附近,破位看2150-2130附近,繼續破位移動止損保利看情況!

瀑布已經開始,反彈就繼續,有單子的慢慢移動止損鎖住收益!想追的根據自身倉位帶好止損,目前技術面已經明顯偏弱,加上美伊談判陷入僵局,各位謹慎抄底!#Gate现货衍生品双双冲进全球前三

- 打賞

- 2

- 1

- 轉發

- 分享

柯南趋势为王:

瀑布已經開始,反彈就繼續,有單子的慢慢移動止損鎖住收益!想追的根據自身倉位帶好止損,目前技術面已經明顯偏弱,加上美伊談判陷入僵局,各位謹慎抄底!特斯马

TSM

創建人@北暖

上市進度

100.00%

市值:

$5324.4

更多代幣

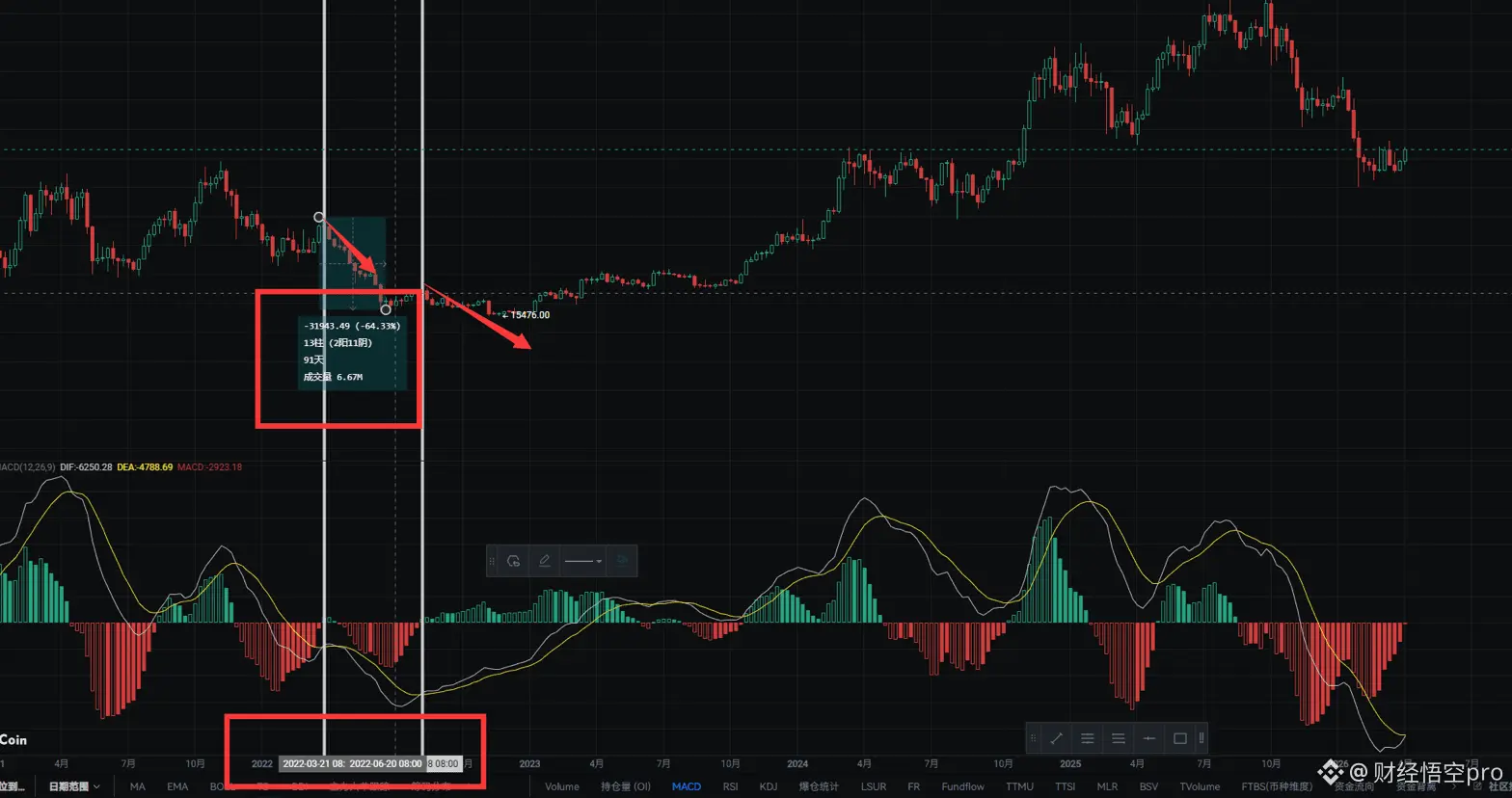

$BTC 比特幣目前MACD周線出現了金叉看漲

但這並不意味著會來一波趨勢線上漲行情

2022年熊市周線金叉信號出現過兩次

之後分別跌了64%和31%

市場都沒有直接反彈,反而繼續下探

幅度一次比一次小,但方向都是向下

提醒大家周線MACD金叉,不能盲目追高

同時,也需要警惕假突破下跌趨勢線情況

即使極限突破7.6萬,也可能走誘多陷阱,

極大概率也是假突破!

定投大餅3倍空單,睡覺踏實幸福☺️#Gate广场四月发帖挑战

但這並不意味著會來一波趨勢線上漲行情

2022年熊市周線金叉信號出現過兩次

之後分別跌了64%和31%

市場都沒有直接反彈,反而繼續下探

幅度一次比一次小,但方向都是向下

提醒大家周線MACD金叉,不能盲目追高

同時,也需要警惕假突破下跌趨勢線情況

即使極限突破7.6萬,也可能走誘多陷阱,

極大概率也是假突破!

定投大餅3倍空單,睡覺踏實幸福☺️#Gate广场四月发帖挑战

BTC-1.55%

- 打賞

- 按讚

- 留言

- 轉發

- 分享

🚀 #GateLaunchesPreIPOS | 早期投資的未來已來臨

傳統金融與Web3正發生重大轉變 — 它正打開曾經只屬於精英投資者的門戶。

💡 有什麼新動向?

Gate 正在推出一種Pre-IPO數字參與模式,允許用戶在高成長私營公司的股份代幣化之前進行投資。

📊 為什麼重要:

🔹 早期接觸 — 在IPO前獲得潛在獨角獸的曝光

🔹 低門檻 — 無需巨額資金或繁瑣的文件

🔹 加密原生 — 使用穩定幣輕鬆投資

🔹 市場前交易 — 價格發現在公開上市前就已開始

🧠 重要見解:

這不僅僅是炒作 — 它是一座由區塊鏈透明度與效率驅動的風險投資機會與散戶投資者之間的結構性橋樑。

🌍 巨大影響:

首次,普通投資者可以:

✔️ 建立包含未上市公司的投資組合

✔️ 進入早期成長階段

✔️ 獲得曾經只限於機構的投資機會

⚠️ 提醒:

高回報伴隨著風險 — 請務必自行研究並明智管理風險敞口。

🔥 核心結論:

#GateLaunchesPreIPOS 不僅僅是一個功能 — 它是一場金融進化,將專屬投資轉變為一個開放的生態系統。

查看原文傳統金融與Web3正發生重大轉變 — 它正打開曾經只屬於精英投資者的門戶。

💡 有什麼新動向?

Gate 正在推出一種Pre-IPO數字參與模式,允許用戶在高成長私營公司的股份代幣化之前進行投資。

📊 為什麼重要:

🔹 早期接觸 — 在IPO前獲得潛在獨角獸的曝光

🔹 低門檻 — 無需巨額資金或繁瑣的文件

🔹 加密原生 — 使用穩定幣輕鬆投資

🔹 市場前交易 — 價格發現在公開上市前就已開始

🧠 重要見解:

這不僅僅是炒作 — 它是一座由區塊鏈透明度與效率驅動的風險投資機會與散戶投資者之間的結構性橋樑。

🌍 巨大影響:

首次,普通投資者可以:

✔️ 建立包含未上市公司的投資組合

✔️ 進入早期成長階段

✔️ 獲得曾經只限於機構的投資機會

⚠️ 提醒:

高回報伴隨著風險 — 請務必自行研究並明智管理風險敞口。

🔥 核心結論:

#GateLaunchesPreIPOS 不僅僅是一個功能 — 它是一場金融進化,將專屬投資轉變為一個開放的生態系統。

- 打賞

- 按讚

- 留言

- 轉發

- 分享

- 打賞

- 1

- 留言

- 轉發

- 分享

底線:Selini 的動作是真正的看跌壓力——他們以 1.73 美元的價格獲得代幣,而 WLD 現在的價格是 0.28 美元,因此他們已經深陷虧損,可能正在清算以增強力量。短期技術反彈是真實的,但看起來有些過度。如果你在關注 WLD,七月的解鎖減少才是值得等待的關鍵結構性催化劑,而不是試圖捕捉當前的波動#GateSquareAprilPostingChallenge

BTC-1.57%

- 打賞

- 按讚

- 留言

- 轉發

- 分享

談判破裂,老美代表團已啟程回國。

這個結果看似意外,實則在情理之中。市場總是這樣——看到停火確認、和談推進,便本能地視為利好追多,卻忽視了一個致命風險:一旦談崩,積壓的利空情緒會集中宣洩,下跌速度遠比上漲更迅猛。

行情從來不是跟隨表面消息波動,而是交易預期與現實之間的落差。這一次,市場正是借"預期落空"完成了情緒反轉。

提前布局的邏輯在於此。此前明確提示72300-73000上方分批建空,並非情緒押注,而是基於風險收益比的提前埋伏。當這根大陰線砸下來時,利潤自然水到渠成。

市場永遠不缺機會,缺的是在一致預期中保持獨立思考,在喧囂中提前下注的定力。

$BTC

#美伊停火协议谈判再生变故

這個結果看似意外,實則在情理之中。市場總是這樣——看到停火確認、和談推進,便本能地視為利好追多,卻忽視了一個致命風險:一旦談崩,積壓的利空情緒會集中宣洩,下跌速度遠比上漲更迅猛。

行情從來不是跟隨表面消息波動,而是交易預期與現實之間的落差。這一次,市場正是借"預期落空"完成了情緒反轉。

提前布局的邏輯在於此。此前明確提示72300-73000上方分批建空,並非情緒押注,而是基於風險收益比的提前埋伏。當這根大陰線砸下來時,利潤自然水到渠成。

市場永遠不缺機會,缺的是在一致預期中保持獨立思考,在喧囂中提前下注的定力。

$BTC

#美伊停火协议谈判再生变故

BTC-1.57%

- 打賞

- 2

- 1

- 轉發

- 分享

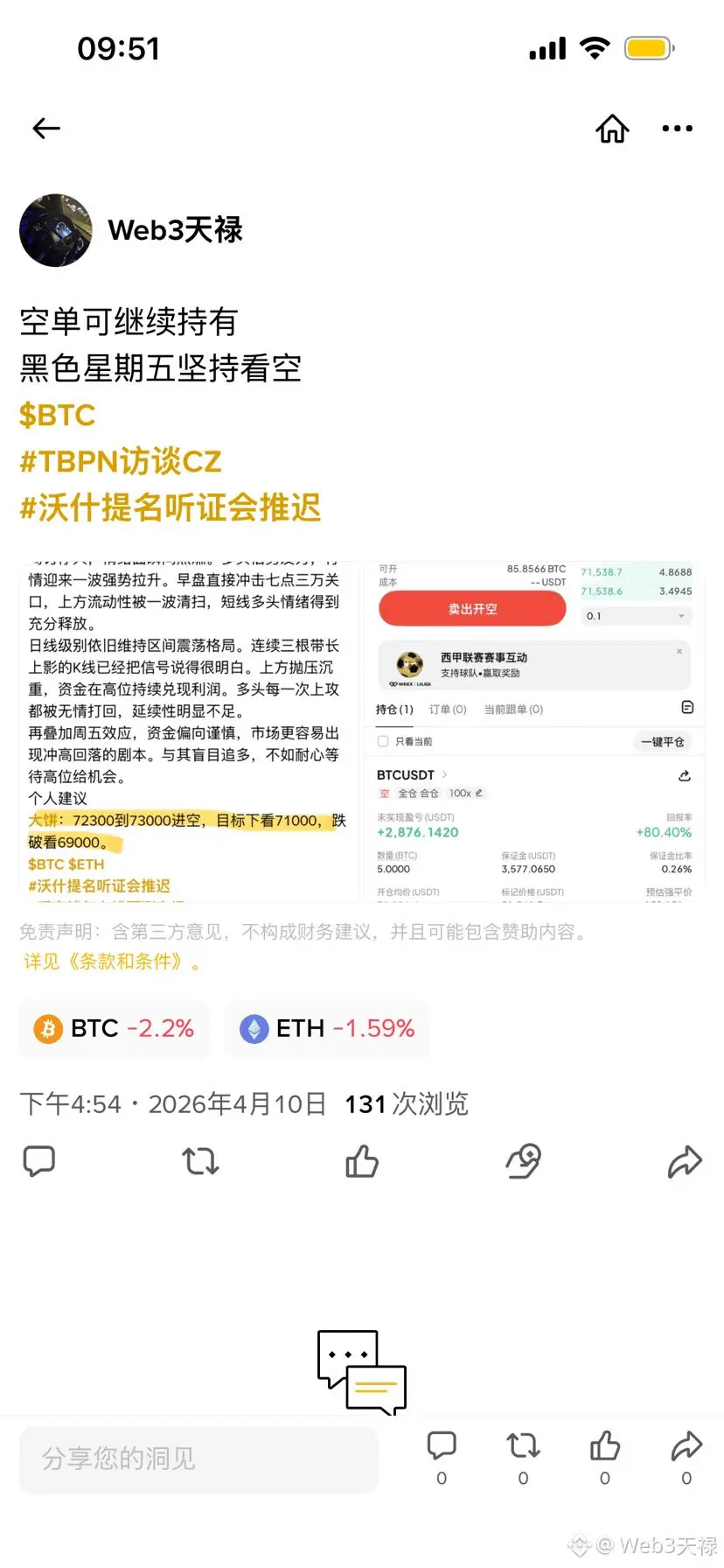

Web3天禄:

亘箪🐧 1677

4746

42

【$BTC 信號】空頭突襲,狙擊反彈衰竭

$BTC 1H級別買盤承接斷層,價格直接砸穿EMA20與布林帶下軌。4H級別MACD柱狀圖加速向下擴張,持倉量穩定背景下價格急跌,空頭主動拋售意圖明確。

🎯方向:做空

⚡入場:現價71550附近直接進場。

🛑止損:69936上方。

🚀目標1:75429。

🚀目標2:77260。

🛡️交易管理:- 執行策略:價格反彈至入場位即視為失敗,果斷離場。目標1區域分批止盈,剩餘倉位推保護損持有。

盘口深度顯示賣單稀疏但買單堆積鬆散,缺乏有效托底。1H RSI已進入超賣區,但4H級別仍處中軌下方,空頭動能尚未耗盡。這種急跌後的弱反彈,往往是二次下探的前兆。盈虧比尚可,但需警惕超賣區間的技術性反抽。

查看實時行情 👇 $BTC

---

關注我:獲取更多加密市場實時分析與洞察! $BTC $ETH $SOL

#Gate上线Pre-IPOs #Gate现货衍生品双双冲进全球前三 #原油小幅上涨

查看原文$BTC 1H級別買盤承接斷層,價格直接砸穿EMA20與布林帶下軌。4H級別MACD柱狀圖加速向下擴張,持倉量穩定背景下價格急跌,空頭主動拋售意圖明確。

🎯方向:做空

⚡入場:現價71550附近直接進場。

🛑止損:69936上方。

🚀目標1:75429。

🚀目標2:77260。

🛡️交易管理:- 執行策略:價格反彈至入場位即視為失敗,果斷離場。目標1區域分批止盈,剩餘倉位推保護損持有。

盘口深度顯示賣單稀疏但買單堆積鬆散,缺乏有效托底。1H RSI已進入超賣區,但4H級別仍處中軌下方,空頭動能尚未耗盡。這種急跌後的弱反彈,往往是二次下探的前兆。盈虧比尚可,但需警惕超賣區間的技術性反抽。

查看實時行情 👇 $BTC

---

關注我:獲取更多加密市場實時分析與洞察! $BTC $ETH $SOL

#Gate上线Pre-IPOs #Gate现货衍生品双双冲进全球前三 #原油小幅上涨

- 打賞

- 1

- 1

- 轉發

- 分享

明月照沟壑:

這是做多還是做空啊?加載更多

加入 4000萬 人匯聚的頭部社群

⚡️ 與 4000萬 人一起參與加密貨幣熱潮討論

💬 與喜愛的頭部創作者互動

👍 查看感興趣的內容

熱門話題

查看更多95.66萬 熱度

964.26萬 熱度

122.23萬 熱度

6.24萬 熱度

143.64萬 熱度

最新消息

查看更多置頂

🎉 Gate 廣場創作者狂歡正式開啟

發文衝榜、社群接龍、分享有獎 — 瓜分 2,000 USDT 及週年禮包

📅 活動時間:4 月 8 日 - 4 月 22 日

✅ 發文衝榜:內容品質 + 互動數據 + 挖礦收益綜合評分瓜分1200 USDT

✅ TG群組打卡:每週抽 3 份週年禮盒 + 7 份 200 U 體驗金券

✅ X 同步獎:分享內容至 X 平台,瓜分 500 USDT 額外獎池

📌 活動詳情:https://www.gate.com/announcements/article/50593

📌 報名連結:https://www.gate.com/questionnaire/7536

#Gate广场 #创作者狂欢 #内容挖矿✍️ Gate 廣場「創作者認證激勵計劃」進行中!

我們歡迎優質創作者積極創作,申請認證

贏取豪華代幣獎池、Gate 精美周邊、流量曝光等超過 $10,000+ 豐厚獎勵!

立即報名 👉 https://www.gate.com/questionnaire/7159

📕 認證申請步驟:

1️⃣ App 首頁底部進入【廣場】 → 點擊右上角頭像進入個人主頁

2️⃣ 點擊頭像右下角【申請認證】進入認證頁面,等待審核

讓優質內容被更多人看到,一起共建創作者社區!

活動詳情:https://www.gate.com/announcements/article/47889#Gate广场四月发帖挑战 狂歡開啟!🧧

發帖即賺,天天都有紅包領,新人100%中獎!

🎁 福利亮點:

✅ 新人禮: 發布廣場首帖,100% 必中紅包!

✅ 發帖獎: 發帖越多,互動越多,紅包金額越大!

✅ 分享王: 轉發活動連結到廣場或外部平台,送 Gate 開瓶器 + 200U!

✅ 衝榜單: Top 100 都有獎,Gate 13 周年限定禮盒、紅牛夾克等您拿!

立即行動,發佈你的四月廣場第一帖!

👉️ https://www.gate.com/post

🗓 截止日期: 4 月 15 日

詳情:https://www.gate.com/announcements/article/50520